研究人员通过使用1400多个GPU和突破性的算法技术模拟了谷歌的53量子比特Sycamore电路,实现了量子计算的重大飞跃。

他们高效的张量网络方法和聪明的“top-k”采样方法大大减少了精确模拟所需的内存和计算负荷。这些策略在更小的测试电路中得到了验证,并且可以塑造量子研究的未来,推动经典系统可以模拟的边界。

模拟谷歌的量子电路

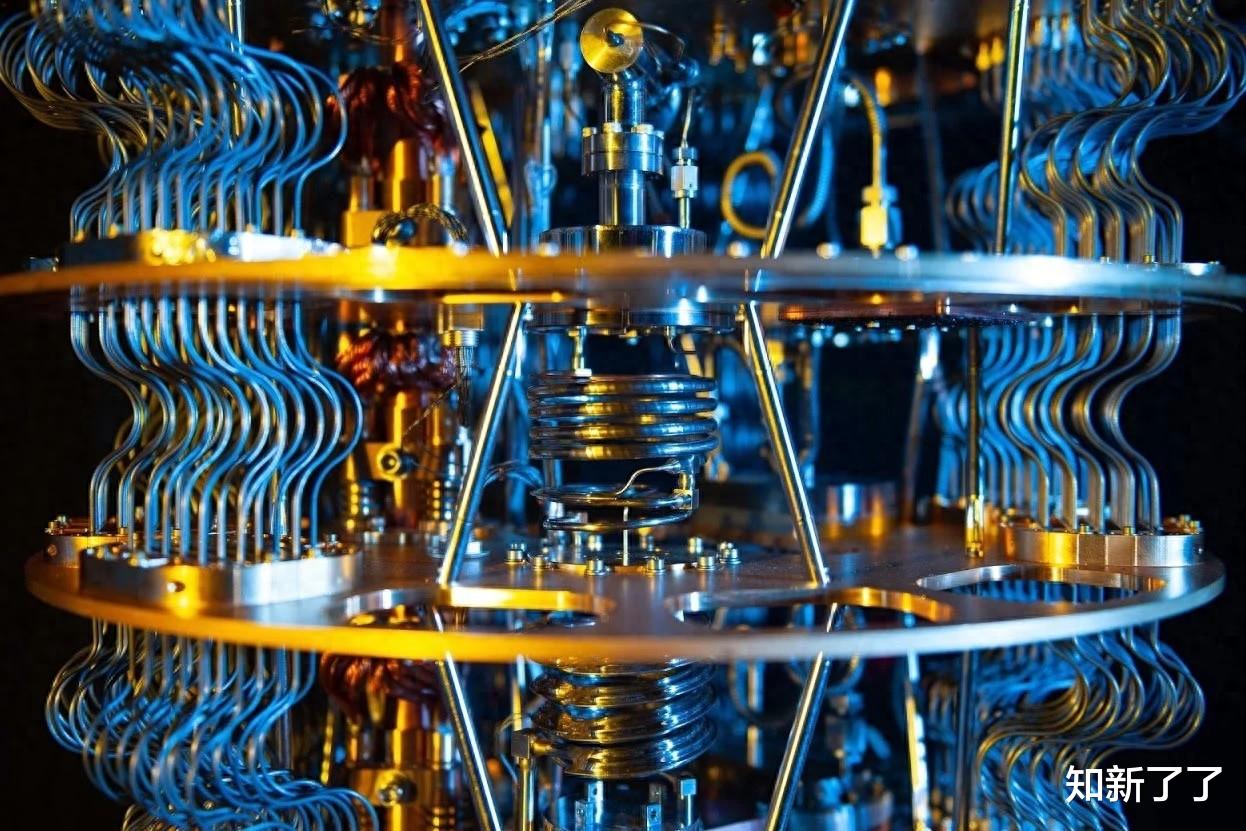

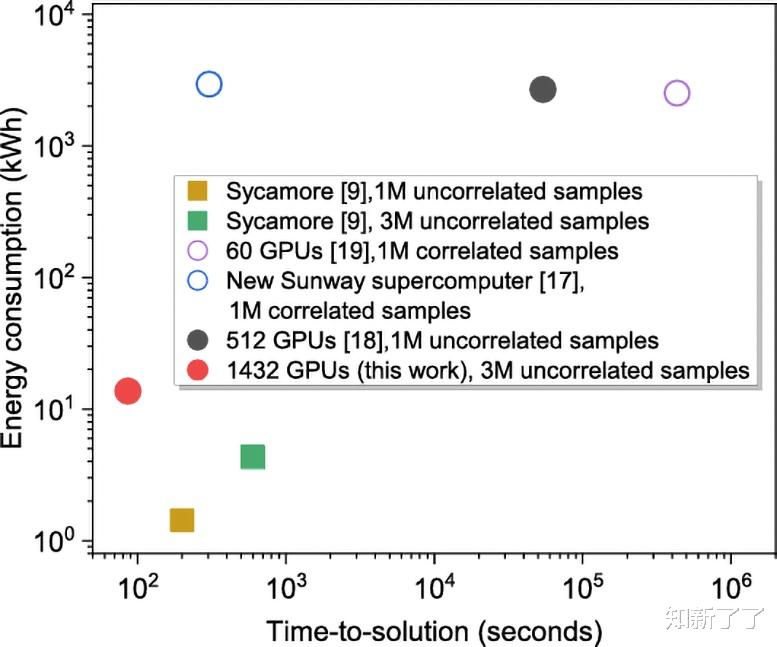

一组研究人员通过成功模拟谷歌的53量子比特、20层Sycamore量子电路,在量子计算领域达到了一个重要的里程碑。这是使用1432个NVIDIA A100 GPU和高度优化的并行算法实现的,为在经典硬件上模拟量子系统打开了新的大门。

张量网络算法的创新

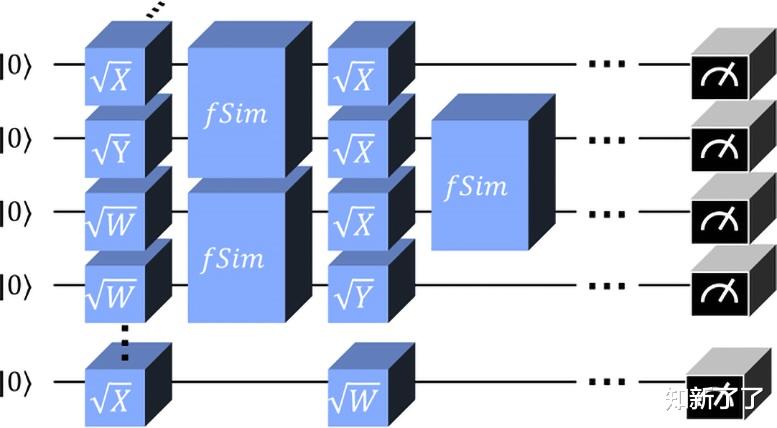

这一成就的核心是先进的张量网络收缩技术,它有效地估计了量子电路的输出概率。为了使模拟可行,研究人员使用切片策略将全张量网络分成更小、更易于管理的部分。这大大降低了内存需求,同时保持了计算效率,使得用相对较少的资源模拟大型量子电路成为可能。

该团队还使用了“top-k”采样方法,从模拟输出中选择最可能的位串。通过只关注这些高概率的结果,他们改进了线性交叉熵基准(XEB) —— 一个衡量模拟与预期量子行为匹配程度的关键指标。这不仅提高了模拟精度,还减少了计算负荷,使过程更快,更具可扩展性。

用更小的电路验证

为了验证他们的算法,研究人员用较小规模的随机电路进行了数值实验,包括一个30量子位,14层的门电路。结果与理论预测的各种张量收缩子网络的XEB值非常吻合。XEB top-k方法的改进的密切值与理论预测,确定算法的精度和效率。

流线型张量收缩性能

该研究还强调了优化张量收缩资源需求的策略。通过改进张量指标的顺序和最小化GPU间的通信,该团队在计算效率方面取得了显著的进步。该策略还表明,基于复杂性估计,增加内存容量(如80GB、640GB和5120GB)可以显著降低计算时间复杂性。每个计算节点使用8×80 GB内存配置可以实现高性能计算。

量子模拟的未来

这一突破不仅为多量子位量子计算机的经典模拟建立了新的基准,而且为未来的量子计算研究引入了创新的工具和方法。通过继续改进算法和优化计算资源,研究人员预计在模拟具有更多量子位的更大量子电路方面取得实质性进展。这项工作代表了量子计算的重大进步,为量子技术的持续发展提供了有价值的见解。

如果朋友们喜欢,敬请关注“知新了了”!